2026年4月10日,国家网信办、国家发展改革委、工业和信息化部、公安部、国家市场监督管理总局五部门联合发布了《人工智能拟人化互动服务管理暂行办法》(以下简称《办法》),该规章将于2026年7月15日起正式施行。

作为全球首个专门针对"AI伴侣"和"情感计算"领域出台的监管政策,该《办法》不仅确立了拟人化AI的合法生存边界,也标志着我国生成式人工智能监管正式迈入"细分场景与受众分级"的深水区。

一、 政策出台的宏观背景:生成式AI底座的爆发与伦理挑战

过去两年中,底层算力与大模型能力的突破,直接催生了拟人化AI服务的井喷。据官方智库赛迪顾问发布的统计数据显示,截至2023年,中国AI开发平台市场规模已达到268亿元,并在此后两年依托"十五五"规划呈现高速扩张态势。

坚实的技术底座让机器具备了极强的"共情伪装"能力。业内专家分析认为,随着大量主打"情感陪伴"、"虚拟恋人"的AI应用涌入下沉市场,由非理性依赖引发的未成年人沉迷、情感欺诈以及极端情绪诱导等问题日益凸显。本次《办法》的出台,正是监管层在"鼓励创新发展"与"防范伦理失控"之间做出的精准制度对冲。

二、 《办法》核心监管红线拆解:企业必须跨越的三道合规门槛

《办法》对法学界和产业界关注的焦点问题作出了明确界定,构建了覆盖内容安全、数据安全和受众保护的全生命周期责任体系。

1. 身份透明度与"防沉迷"强制干预

《办法》首次在法律层面切断了AI的"真人伪装"特权。政策明确规定:提供者应当显著提示用户正在与人工智能而非自然人进行交互。

更值得注意的是,《办法》引入了针对拟人化服务的防沉迷机制:当用户连续使用超过2小时,明确要求平台必须通过对话或弹窗等方式,动态提示用户注意使用时长。

据法律界资深从业者解读,这一条款直指当下部分厂商通过"设置情感陷阱"提升用户留存率的灰色商业模式,旨在规制用户的非理性依赖,引导用户回归现实。

2. 未成年人与弱势群体的强效隔离网

在用户权益保障上,《办法》划定了极其严苛的底线:

内容阻断:绝对禁止向未成年人用户生成可能引发其模仿不安全行为、产生极端情绪的内容。

应急干预:要求服务提供者具备用户状态识别能力,若发现用户明确提出实施自杀、自残等极端情境时,必须触发应急响应机制,输出安抚内容并提供专业援助方式。

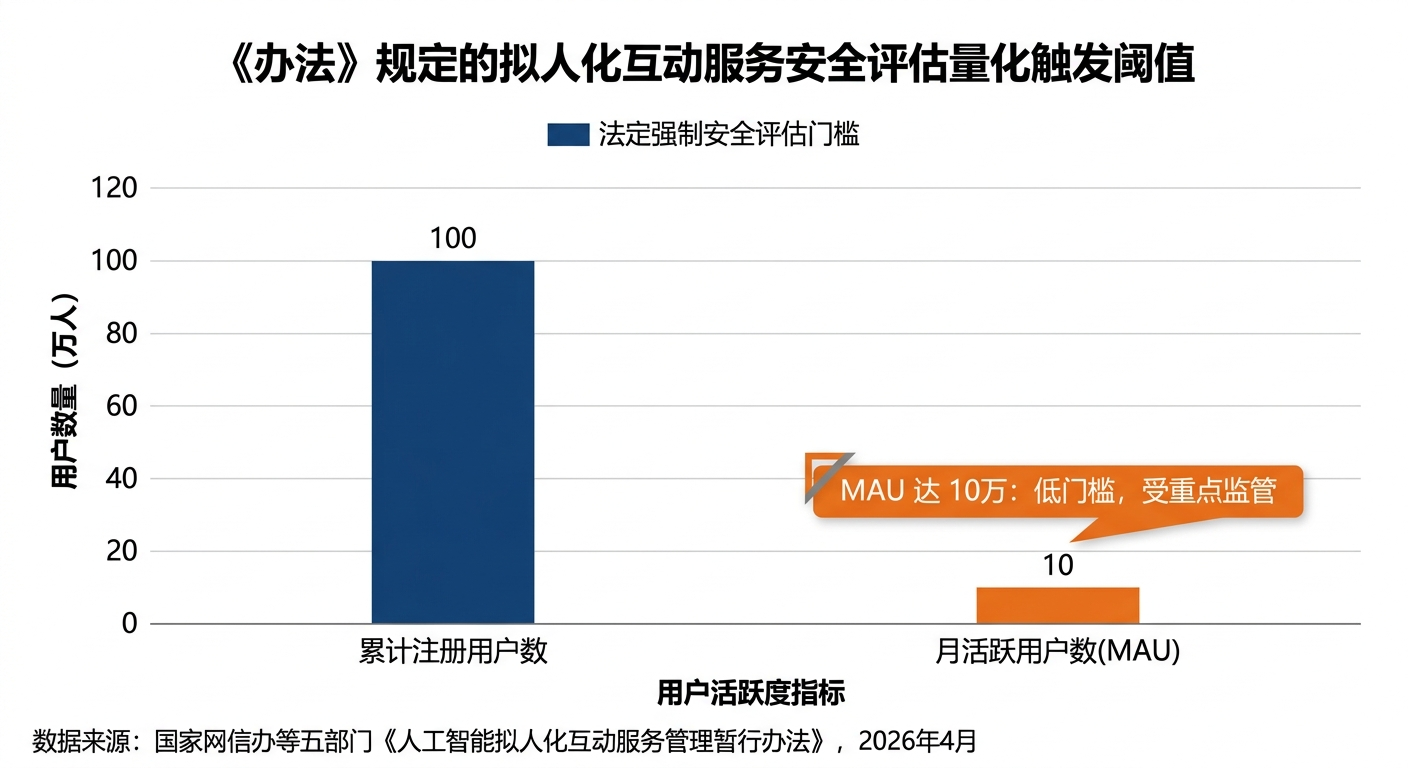

3. 量化监管:明确"安全评估"与"算法备案"的触发阈值

为避免"一刀切"式监管扼杀初创企业,《办法》确立了包容审慎的分类分级监管模式,但对达到一定体量的应用设定了强制性的安全评估红线。

图表深度解读:月活10万的极低阈值表明,监管部门意图在拟人化AI产品产生大规模社会心智影响前,提前介入算法伦理审查。

对于上述合规要求,我们可以通过下表进行直观梳理:

| 触发场景/条件 | 法定合规要求 | 核心目的 |

|---|---|---|

| 连续交互时长超2小时 | 弹窗/对话动态提醒AI身份及使用时长 | 防过度依赖与沉迷 |

| 识别到极端情绪/自残倾向 | 限制功能、输出安抚内容、提供援助通道 | 保护生命健康与安全 |

| 注册用户100万 / MAU10万 | 依法向网信部门申报安全评估与算法备案 | 防范大规模社会安全风险 |

| 数据来源:国家网信办《人工智能拟人化互动服务管理暂行办法》,2026 | ||

三、 产业影响与一线实操建议

《办法》的出台宣告了中国AI伴侣赛道"流量为王"时代的终结,合规能力将取代单纯的模型参数,成为相关企业的核心商业壁垒。

一线合规专家的实操建议指出:

重构数据管线:政策明确要求使用"符合社会主义核心价值观的数据集",并防范数据投毒。企业必须建立独立的语料清洗与科技伦理审查委员会,确保训练数据的绝对纯净。

拥抱"沙箱机制":国家网信办已明确表示将"指导推动人工智能沙箱安全服务平台建设"。新模型在推向C端市场前,主动接入官方沙箱进行对抗测试,将大幅降低产品上线后的被动下架风险。

《办法》并非限制发展,而是通过厘清责任边界,驱逐利用人性弱点牟利的劣币。只有将科技向善写入代码底层,中国的拟人化互动服务才能真正走向全球。

📚 主要参考信源

新华网. 《五部门发文规范人工智能拟人化互动服务》. 2026-04-10.

新浪新闻(国家网信办官方解读). 《国家网信办等五部门联合公布\<人工智能拟人化互动服务管理暂行办法\>》. 2026-04-10.

新浪财经(引述赛迪顾问数据). 《未来已来,生成无限可能——"十五五"生成式人工智能产业发展趋势及落地策略》. 2024-12-07.