2026年3月底,于中关村论坛年会"医学AI创新与发展大会"期间,中国生物医学工程学会等40余家权威机构联合发布了《医疗机构人工智能应用与治理专家共识(2026版)》(以下简称《共识》)。这一由顶尖卫生与科研机构联合背书的行业文件,标志着中国医疗AI产业正式从技术狂飙的"野蛮生长"阶段,迈入以安全有效为核心的"标准化治理"全新周期。

本文将严格遵循宏观政策导向,深度拆解该《共识》的核心逻辑,为医疗卫生管理者及AI产业从业者提供合规落地的实操指引。

一、 宏观背景:AI医疗迈入"规模化落地与强监管"双重周期

当前,我国医疗人工智能正处于政策与技术双轮驱动的爆发期。政策层面,国家卫健委等五部门于2025年11月联合印发《关于促进和规范"人工智能+医疗卫生"应用发展的实施意见》,明确了临床诊疗、公共卫生等8个方向的24项重点应用。

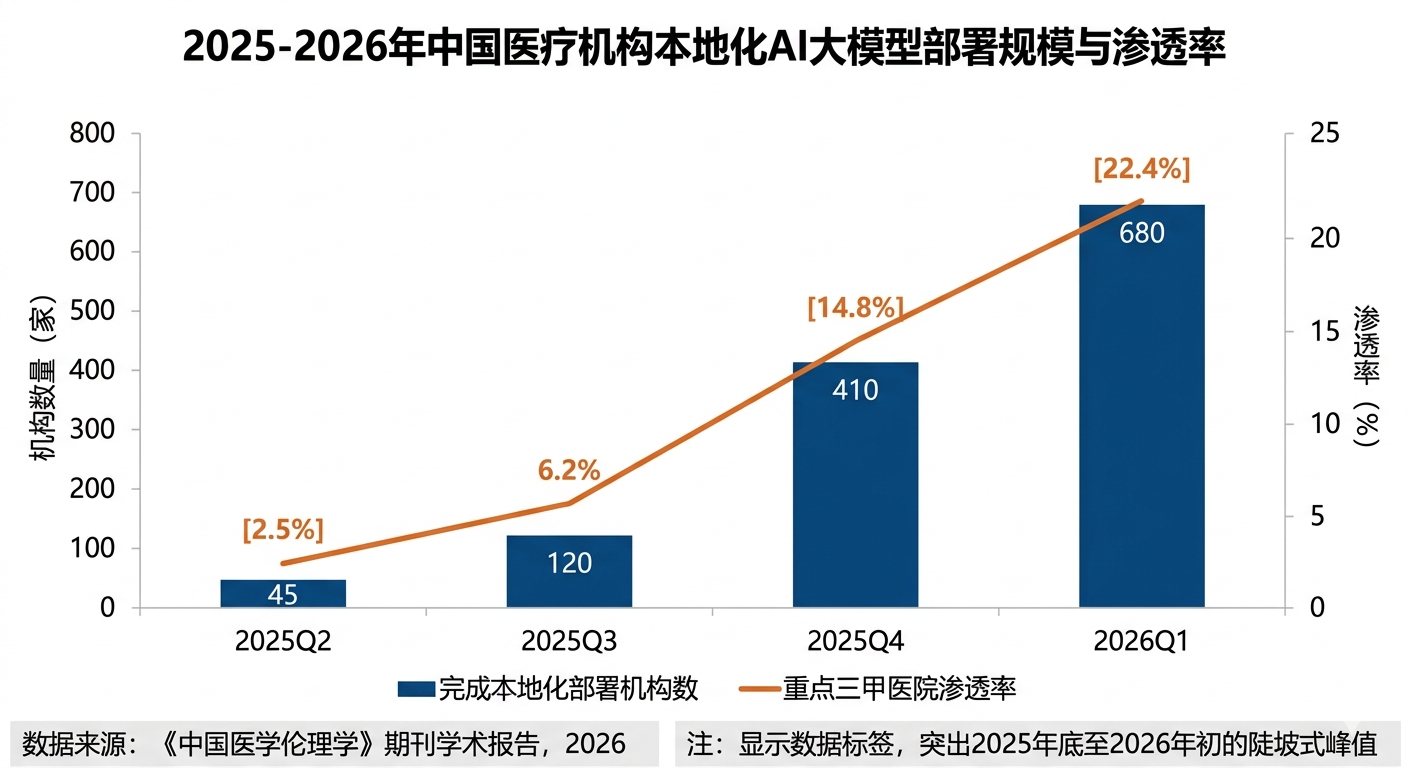

在技术落地层面,新一代国产AI大模型的产业渗透率正呈指数级攀升。《中国医学伦理学》期刊发表的相关调研数据显示,自去年高性价比大语言模型发布后,仅在两个月内国内便有超400家医疗机构完成了本地化部署。

业内专家分析认为,基于持续学习与迭代更新的AI自主演化特性,正与传统医疗器械的静态监管模式产生本质冲突。出台针对应用终端的专项治理体系,化解创新与监管的摩擦,已成为医疗行业数字化转型的先决条件。

二、 核心拆解:《共识》六大维度的治理逻辑

《共识》创新性地构建了覆盖全生命周期的六大治理维度:准入审查、临床应用、患者权利保障、数据治理、风险管理以及素养提升。其中,建立多学科联合评估机制与建立动态风险分层体系是此次文件的核心亮点。

| 风险级别 | 核心特征与代表性应用场景 | 对应监管与准入机制 |

|---|---|---|

| 低风险 | 管理流程优化、患者随访管理、医学文献高效检索 | 适用简化备案制,由机构内部进行常规效能评估 |

| 中风险 | 医学影像辅助识别、临床决策支持系统(CDSS) | 需医疗机构伦理委员会与技术委员会双重严格审查 |

| 高风险 | 侵入性手术机器人辅助、重症生命体征自动干预 | 必须具备国家器械注册证,强制设置人工干预"熔断机制" |

数据来源:中国医学科学院北京协和医学院等起草单位专家解读,2026

三、 关键争议与落地实操:"数据不出院"与"医务人员兜底"

1. 数据隐私红线:构建本地化隔离墙

在数据治理环节,"数据不出院"是当前医疗机构引入AI大模型的一条不可逾越的红线。 《共识》明文强调了隐私保护与数据价值归属的重要性。清华大学附属北京清华长庚医院法务部相关专家指出,由于医疗健康数据具备极高敏感性与财产属性,现阶段合规的实操方案主要依赖于在医院内部私有化算力集群进行模型的微调与推理,以此在物理与网络架构源头阻断核心数据公有云传输的泄露风险。

2. 伦理与责任主体:AI重申"助手"定位

面对临床诊断错误由谁担责的核心争议,《共识》在临床应用伦理上坚定了"人机协同,以人为主"的法理底线。

国务院发展研究中心及卫生法学界相关学者推演指出,不论未来医学AI的准确率达到何种高度,医师必须拥有疾病诊断的最终决策权,且医疗机构需承担诊疗行为的最终法律责任。这意味着,AI工具在现阶段的法律地位被严格限定为医师的"外脑"与"高级助手",必须服务于医疗人文关怀,绝不能成为"替代者"。

四、 市场演进与真实世界案例剖析

将宏观政策投射至一线临床,真实世界的业务数据展现了AI在合规治理下的巨大赋能潜力。

以中医智能问诊与辅助决策平台为例。据潮新闻2026年3月的追踪报道,国内某主流中医数智平台已安全合规沉淀了超过1200万条真实处方与2000万条诊疗记录。 分析显示,在严格遵守医务人员最终复核义务的前提下,该AI系统通过对海量非结构化古籍与名医医案的深度学习,在心血管等垂直专科领域实现了96%以上的辅助处理准确率。这不仅验证了AI赋能基层优质医疗资源下沉的可行性,也印证了规范化治理并不会阻碍技术商业化进程,反而能筛除"劣币",加速高质量模型的落地。

图表深度解读:本地化部署机构数在2025年底呈现指数级爆发,表明数据合规需求正强势驱动医疗IT基础设施的新一轮重构。

📚 主要参考信源

新浪财经/中国科学报. 《医疗机构人工智能应用与治理专家共识(2026版)》发布. 2026-04-03.

中国经济网. 《医学AI创新与发展大会举办》. 2026-03-30.

潮新闻. 《智能问诊时代,谁来为健康"把关"?》. 2026-03-30.

梅斯医学. 《医疗机构人工智能应用与治理专家共识(2026 版)》. 2026-04-01.